AI倫理とは

AI倫理とは、人工知能(AI)が社会に与える影響やその利用に関する道徳的、倫理的な問題を考察する学問領域です。

AI技術が進化する中で、これらの技術が人間の生活や社会にどのような影響を及ぼすかを評価し、適切な使用を促すことが求められています。

AI倫理は、技術の開発者や利用者にとって重要な指針となり、持続可能な社会の実現に寄与します。

具体的には、プライバシーの保護、公正性、透明性、責任などの観点から、AIの利用についてのルールやガイドラインが必要とされています。

- AI倫理はAI技術の社会的影響を考える学問である。

- プライバシーや公正性の観点からの考察が重要である。

- 持続可能な社会の実現に寄与することが目的である。

AI倫理の重要性

AI倫理が重要視される理由は、AI技術が日常生活に深く浸透し、さまざまな分野で活用されているからです。

医療、金融、教育など多岐にわたる分野でAIが導入される中で、その決定が人々の生活に直接的な影響を及ぼす可能性があります。

たとえば、AIを用いた医療診断では、正確さや公平性が求められます。

誤った判断が下されると、患者の生命に関わる重大な結果を招くことがあります。

したがって、AI技術の開発者や運用者は、倫理的な観点からの責任を持つ必要があります。

- AI技術の普及により、その影響が広範囲に及ぶ。

- 医療や金融などの分野で倫理的な判断が求められる。

- 開発者や運用者の責任が重要視される。

AI倫理の原則

AI倫理にはいくつかの基本的な原則があります。

これらの原則は、AIの開発と利用において遵守されるべきガイドラインとされています。

以下のような点が挙げられます。

1. **公正性**:AIは特定の人々や集団に対して不公平に働きかけることがあってはならない。

2. **透明性**:AIの判断や行動がどのように行われるのかを明確にする必要がある。

3. **プライバシー**:個人情報を適切に保護し、ユーザーの同意を得ることが求められる。

4. **責任**:AIの結果に対して誰が責任を持つのかを明確にする必要がある。

5. **持続可能性**:AIの利用が社会や環境に与える影響を考慮する必要がある。

- 公正性、透明性、プライバシーが基本的な原則である。

- 責任の所在を明確にすることが重要である。

- 持続可能性も考慮されるべきである。

AI倫理に関する国際的な取り組み

AI倫理に関する国際的な取り組みは、世界中で進められています。

多くの国や組織が、AI技術の開発と利用に関する倫理的ガイドラインを策定しています。

例えば、OECD(経済協力開発機構)は、AIの倫理的利用に関する原則を示しています。

また、EU(欧州連合)もAIに関する規制の枠組みを構築し、倫理的な視点を重視した政策を策定しています。

これらの取り組みは、国際的な基準を設けることで、AIの利用が倫理的に行われることを促進しています。

- OECDやEUが倫理的利用の原則を示している。

- 国際的な基準を設けることで促進される。

- 各国の取り組みによって、持続可能な利用が進む。

AI倫理と技術の進化

AI倫理は、AI技術の進化とともに変化する必要があります。

新しい技術が開発されるたびに、それに伴う倫理的課題も浮上するため、常に最新の状況に対処するためのフレームワークが必要です。

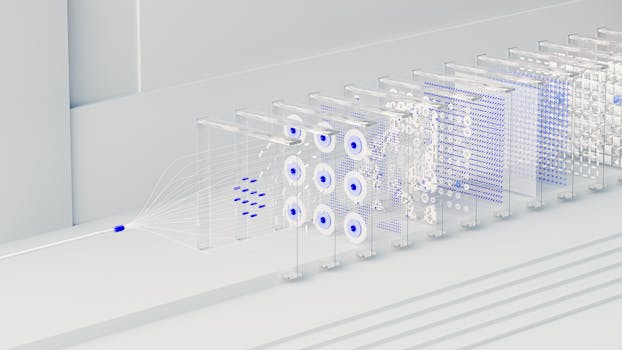

特に、機械学習や深層学習といった技術は、データの偏りや不正確さが結果に影響を及ぼす可能性があるため、注意が必要です。

AIの判断がどのように行われるかを理解し、適切な倫理基準を適用することが求められます。

- 技術の進化に伴い倫理的課題が変化する。

- 新たな技術に対して常に最新のフレームワークが必要である。

- データの偏りに注意が必要である。

AIとバイアス

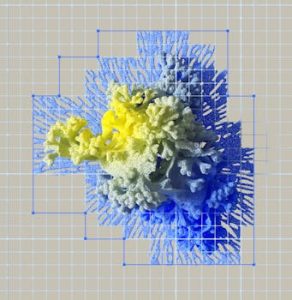

AIシステムは、大量のデータを学習することでその判断を行いますが、学習するデータにバイアスが含まれている場合、AIの判断も偏ったものとなります。

バイアスは、特定の社会的グループに対して不公平な結果をもたらす可能性があります。

したがって、AI倫理の観点からは、データの収集や選定が重要です。

バイアスを避けるためには、多様なデータセットを使用し、継続的に評価を行うことが求められます。

- AIの判断がデータのバイアスに影響される。

- データ収集の段階からの配慮が必要である。

- 多様なデータセットを用いることが重要である。

AIとプライバシーの問題

AI技術の進化に伴い、プライバシーの問題も深刻化しています。

AIは個人情報を大量に処理するため、その運用には十分な配慮が必要です。

特に、個人情報がどのように収集され、利用されるかを明確にし、ユーザーに対して透明性を持つことが求められます。

また、ユーザーが自らの情報を管理できる権利を尊重することも重要です。

これにより、信頼されるAIシステムの構築が進むでしょう。

- AIは個人情報を大量に処理する。

- 透明性を持つことが求められる。

- ユーザーが情報を管理できる権利を尊重することが必要である。

AI倫理と社会的責任

AI倫理は、単なる技術的な問題にとどまらず、社会的責任を伴います。

企業や研究機関は、AI技術がもたらす影響を理解し、社会に対して責任を持つ必要があります。

特に、AIが人々の生活に与える影響を考慮し、倫理的な判断を行うことが求められます。

これにより、AIの利用が社会全体にとって有益なものとなるようにすることが重要です。

- AI技術は社会的責任を伴う。

- 企業や研究機関は倫理的判断を行う必要がある。

- 社会全体にとって有益な利用を目指すことが重要である。

まとめ

AI倫理は、人工知能がもたらす社会的な影響を考慮し、その利用に関する道徳的な問題を扱う重要な領域です。

公正性、透明性、プライバシー、責任、持続可能性といった原則があり、技術の進化に伴って常に更新される必要があります。

AI技術の発展により新たな課題が生じる中で、国際的な取り組みや各国の政策が重要な役割を果たしています。

最終的には、AIの利用が社会全体にとって有益であることを目指し、倫理的な観点からの責任を持つことが求められます。

AI倫理の理解を深めることで、より良い未来を築くための一助とすることができるのです。